はじめに

AIに同じ指示を出しているのに、毎回違うものが返ってくる。

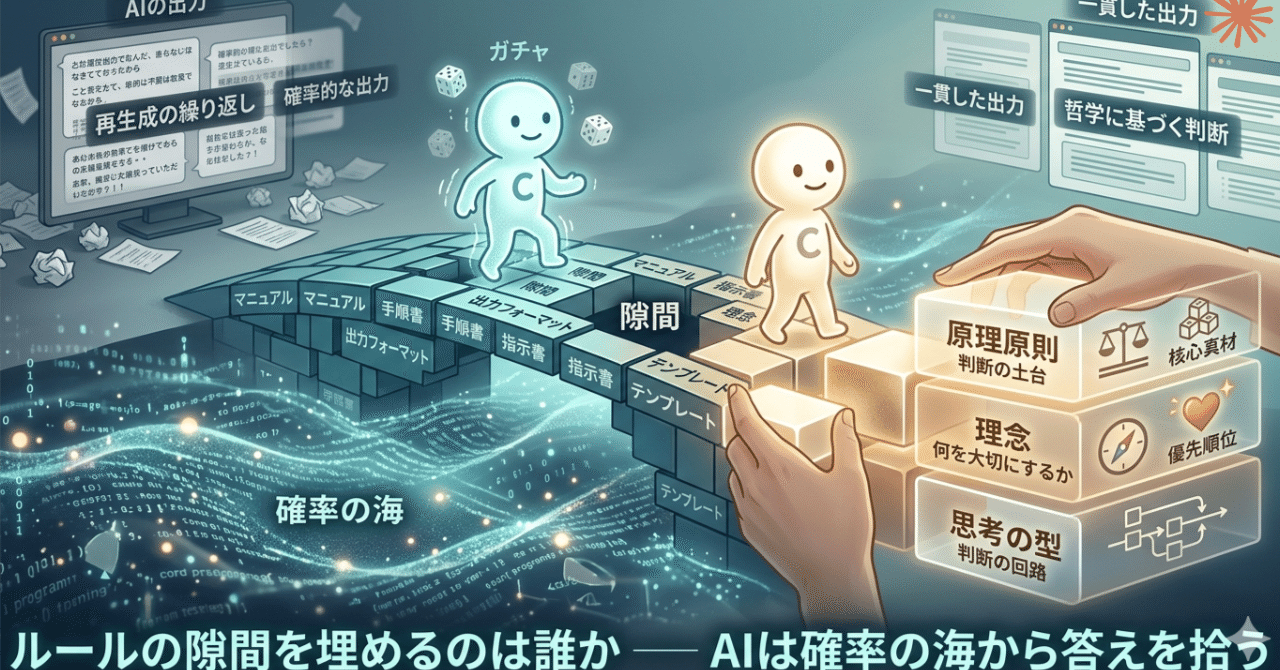

この経験に心当たりのない人は、おそらくAIをまだ本格的に業務で使っていない人だろう。実際に使い込めば、必ずこの壁にぶつかる。同じプロンプト、同じ条件、同じ文脈。それなのに、昨日は期待通りの出力が返ってきたのに、今日はまるで見当違いなものが返ってくる。

多くの人はこれを「AIの出力は確率的だから仕方ない」と受け入れている。そして対処法として選ばれるのは、何度も再生成を繰り返すことだ。5回出力させて、一番マシなものを選ぶ。10回繰り返して、ようやく使えるものが1つ出てくる。

これはガチャだ。良い結果が出るまで回し続ける。AI活用の現場で、これが日常になっていないだろうか。

しかし、本当に「確率的だから仕方ない」で終わらせていいのか。ここには、もっと構造的な問題が隠れている。

人間の部下は、ブレない

同じ問いを、別の角度から考えてみたい。

もしあなたの部下に「この案件の提案書を作ってくれ」と依頼したとする。同じ案件、同じ依頼内容で、月曜に頼んでも金曜に頼んでも、毎回まったく違うものが出てくるだろうか。

出てこない。

もちろん体調や気分による多少の差はあるだろう。しかし、提案書の構成がまるで変わったり、クライアントへのトーンが180度ひっくり返ったり、優先順位が毎回入れ替わったりはしない。なぜか。

その人の中に、暗黙の判断基準があるからだ。

「この会社では、まず顧客の課題から入る」「提案は結論から書く」「このクライアントには丁寧すぎるくらいがちょうどいい」。こうした判断基準の多くは、マニュアルには書かれていない。しかし、経験と価値観と、組織の中で吸収した暗黙の文化が、その人の出力に一貫性を与えている。

つまり、人間は指示の「隙間」を、自分の中にある哲学で埋めている。

指示書にはすべてを書き切れない。どんなに詳細な依頼をしても、判断を要する余白は必ず残る。人間はその余白を、自分の中にある判断原則——言語化されていなくても確かに存在する哲学——で埋めて、一貫した出力を返す。

AIにはこれがない。

確率の海からサイコロを振る

AIには暗黙の哲学がない。だからAIは、指示の隙間に立ったとき、自分の中の判断原則に立ち返ることができない。代わりに何をしているかというと、確率の海からサイコロを振って答えを拾っている。

大規模言語モデルの出力は、本質的に確率的だ。同じ入力に対しても、次に来る単語の候補は複数あり、その中から確率的に選ばれる。指示が明確で選択の余地がない部分では出力は安定するが、判断を要する隙間——まさに人間なら哲学で埋める部分——では確率の揺れがそのまま出力のブレになる。

ここで、多くの人がやっていることを改めて見てみよう。

ガチャを回す。何度も再生成して、良い結果が出るまで繰り返す。

この行為の正体は何か。哲学の不在を、試行回数で埋めようとしている。

人間の部下なら哲学が埋めてくれる隙間を、AIは確率で処理する。だから結果がブレる。そのブレを、回数を重ねることで確率的に「当たり」を引こうとしている。これはAI活用ではない。確率との消耗戦だ。

「ならばプロンプトをもっと精緻にすればいい」と考える人もいるだろう。しかし、どれだけルールを積み上げても、すべての隙間は埋まらない。ルールを100個書いても、101個目の判断が必要な場面は必ず出てくる。プロンプトの精緻化はメソッドの積み上げにすぎない。メソッドでは、確率は収束しない。

哲学を渡したら、変わった

この問題に対する答えを、自分たちの開発現場で見つけた。

Philosophy as Codeの開発において、AIに渡すものを根本から変えた。ルールの集合ではなく、哲学を渡した。

具体的には、CLAUDE.mdと呼ぶファイルに三つの層を定義してAIに渡している。そしてこの三層の各々が、確率の海を異なる角度から狭めている。

第一層は原理原則——判断の土台を固定する。 「世界はこう動いている」という構造的事実を渡すと、AIの出力の基盤そのものが安定する。たとえば「メソッドだけでは未知に対応できない」という原理を渡すと、AIはルールの列挙に逃げず、上位の判断原則を探す方向に動く。土台が固まれば、サイコロの振れ幅は小さくなる。

第二層は理念——隙間での選択にランダム性をなくす。 「何を最も大切にするか」を明示すると、判断を要する隙間に立ったとき、AIは確率に委ねる代わりに理念に照らして選ぶようになる。人間の部下が「うちの会社ではこうする」という暗黙の価値観で判断するのと同じ構造だ。優先順位が明示されていれば、迷いが消える。

第三層は思考の型——判断の回路を固定する。 「哲学からメソッドの順で考えろ」「正しさを先に定義しろ」という思考プロセスを渡すと、AIは毎回同じ回路を通って判断に至る。回路が固定されるから、同じ問いに対して同じ道筋を辿る。出力がブレない。

この三層をAIに渡した結果、同じタスクに対するブレの幅は明確に狭まった。想定外の状況に遭遇しても、三層に立ち返って判断を導出するから、出力が散らばらない。人間の部下が暗黙の判断基準で隙間を埋めるのと、構造的に同じことが起きた。

武術に例えれば、技を100個覚えても101番目の攻撃には対応できない。しかし「中心線を守る」「最短距離で反応する」という原理を体に染み込ませた武術家は、見たことのない攻撃にも対応できる。個別の技ではなく原理で動いているからだ。AIにとっての哲学も、これと同じ機能を果たす。

ルールの隙間を埋めるのは、哲学だけだ

ここまで読んで、改めて問いたい。

あなたの組織には、AIに渡せる「哲学」があるだろうか。

AIにプロンプトを渡すとき、渡しているのは何か。業務手順書か、テンプレートか、出力フォーマットの指定か。それらはすべてルール——メソッド——だ。ルールを精緻にすればするほど想定内の出力は改善されるが、想定外への対応力は一切変わらない。そしてAIは、ルールの隙間に立つたびに、確率の海からサイコロを振り続ける。

人間がルールの隙間を埋めていた時代には、この問題は見えなかった。優秀な社員が、マニュアルに書かれていない判断を暗黙のうちに補完していたからだ。しかしAIはそれをしない。AIはルールの隙間を埋めない。隙間があれば、確率に委ねるだけだ。

AIという存在は、組織が本当は何を考えていたのか——あるいは何も考えていなかったのか——を映し出す鏡でもある。哲学がある組織は、AIにもその哲学を渡せる。哲学がない組織は、ルールを積み上げることしかできず、永遠にガチャを回し続ける。

ルールの隙間を埋めるのは、哲学だけだ。

そして、その哲学を定義するのは、AIではなく人間にしかできない仕事だ。

もし今日、最初の一歩を踏み出すなら、これだけでいい。「うちの組織が最も大切にしていることは何か」を、一行で書いてみること。書けなければ、それが答えだ。書けたなら、それがあなたの組織の哲学の最初の一行になる。